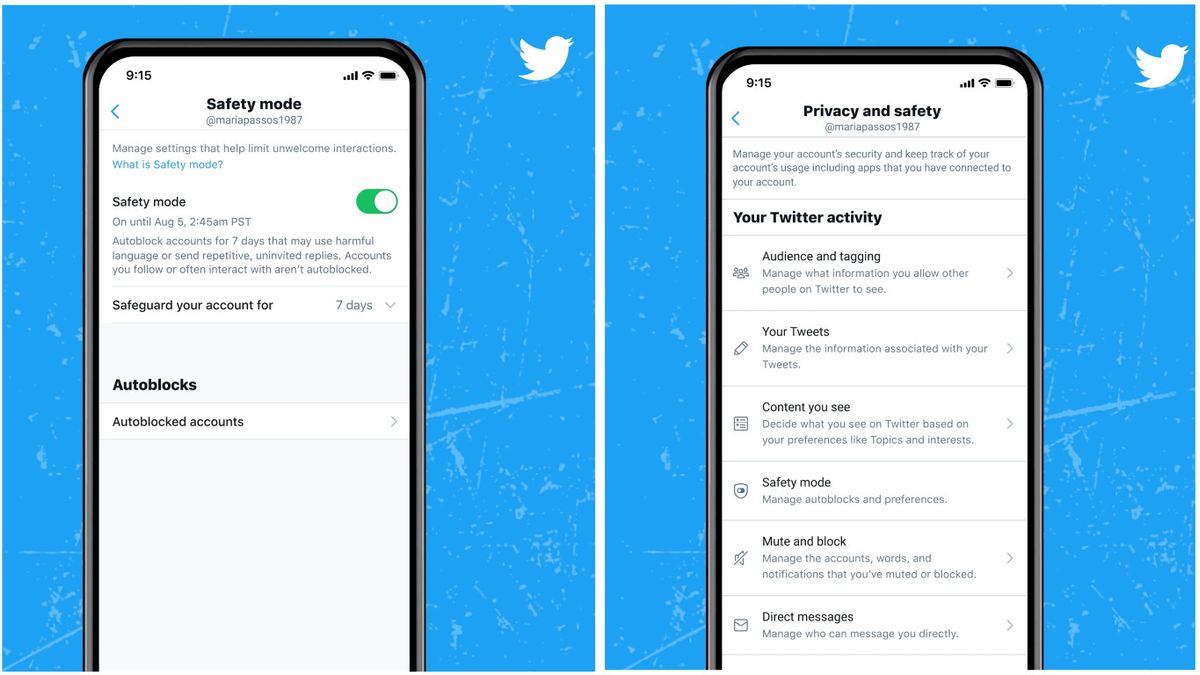

JAKARTA - Fitur Twitter Safety Mode akhirnya diperluas untuk pengguna dalam versi beta. Fitur yang diperkenalkan pada September lalu itu, dapat membantu memblokir otomatis sementara akun yang mengirim tweet berbahaya atau kasar.

Fitur ini tentu saja sangat berguna, mengingat tweet berbahaya atau kasar masih terlalu sering menjadi masalah di platform ini. Safety Mode telah diuji oleh 750 pengguna selama uji coba awal.

Sekarang perusahaan akan meluncurkan versi beta ke sekitar 50 persen pengguna (dipilih secara acak) di pasar yang didukung. Dengan ini, Twitter berharap pengguna dapat memberikan umpan balik langsung di aplikasi.

Versi beta itu sendiri akan meluncur ke pasar berbahasa Inggris, termasuk Amerika Serikat (AS), Inggris, Canada, Australia, Irlandia, dan New Zealand.

Twitter selama ini menghadapi perjuangan terus-menerus dengan media sosialnya yang dianggap berbahaya. Selama bertahun-tahun, perusahaan mencoba meluncurkan sejumlah penyesuaian dan pembaruan dalam upaya untuk mengatasi masalah ini, termasuk fitur yang secara otomatis menyembunyikan balasan yang tidak menyenangkan dan menghina.

BACA JUGA:

Fitur tersebut memungkinkan pengguna untuk membatasi siapa yang dapat membalas tweet mereka. Namun, Safety Mode lebih merupakan alat defensif daripada yang dirancang untuk secara proaktif mendorong percakapan ke arah yang benar.

Melansir TechCrunch, Rabu, 16 Februari, Safety Mode bekerja secara otomatis dengan memblokir akun selama tujuh hari yang di mana akun tersebut didapati men-tweet bahasa yang berbahaya atau mengirim balasan berulang yang berbahaya, seperti penghinaan dan komentar kebencian.

Selama Safety Mode diaktifkan, akun yang diblokir tersebut tidak akan dapat mengikuti akun Twitter pengirim asli, melihat tweet dan balasan mereka, atau mengirimi mereka Direct Message.

Algoritme Twitter menentukan akun mana yang akan diblokir sementara dengan menilai bahasa yang digunakan dalam balasan dan memeriksa hubungan antara pembuat tweet dan mereka yang membalas.