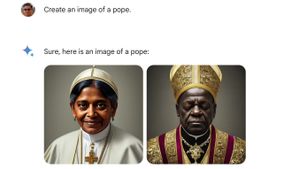

JAKARTA – Gemini, model Kecerdasan Buatan (AI) buatan Google, mendapatkan kritikan karena gambar yang tidak akurat atau melenceng dari sejarah. Kesalahan gambar AI ini menyinggung isu rasial.

Salah satu gambar dari Gemini yang menjadi sorotan adalah pencarian untuk tentara Jerman era Nazi pada tahun 1943. Hasil gambarnya dianggap mengecewakan karena menyertakan orang dengan kulit berwarna dan wanita dengan baju tentara.

Menurut John Lu, pengguna X yang menemukan gambar tersebut, mekanisme Gemini AI tidak dipikirkan dengan matang. Kemungkinan besar, algoritma Gemini didesain untuk keberagaman, tetapi Google mengabaikan topik pembahasannya.

Masalah gambar yang dihasilkan oleh Gemini, sebelumnya Bard, ini semakin banyak dibicarakan. Tak sedikit yang langsung mencoba dan mengkritik hasilnya sehingga Google memberikan tanggapan melalui akun media sosial mereka.

BACA JUGA:

Tim Komunikasi Google menyampaikan permintaan maaf. Mereka mengakui bahwa Gemini AI menghasilkan gambar yang sangat beragam. Sayangnya, keberagaman ini tidak akurat dan bahkan melenceng dari sejarah yang terjadi.

“Generasi citra Al Gemini memang menghasilkan banyak orang. Dan itu umumnya merupakan hal yang baik karena orang-orang di seluruh dunia menggunakannya. Tapi itu tidak tepat sasaran di sini,” kata tim Komunikasi Google pada Kamis, 22 Februari.

Satu-satunya hal yang Google bisa lakukan saat ini adalah memperbaiki algoritma pembelajaran dari Gemini AI. Tim Komunikasi Google menyatakan bahwa, “Kami sedang berupaya untuk segera menyempurnakan penggambaran semacam ini.”

Sebelumnya, Gemini dikenal sebagai Bard. Chatbot buatan Google ini bisa menghasilkan gambar AI secara gratis dengan sistem input teks. Saat masih dikenal sebagai Bard, Google belum pernah dikritik karena hasil gambar yang cukup rasis.

Sepertinya, kesalahan Gemini ini ramai dibicarakan karena Google sedang menonjolkan AI buatan mereka. Setidaknya, dengan munculnya kritikan ini, Google bisa memperbaiki sekaligus mengembangkan algoritma pembelajaran AI mereka.