JAKARTA - Divisi AI dari Meta Platform Inc. mulai memperkenalkan Massively Multilingual Speech (MMS) secara publik, sebuah proyek teknologi AI text-to-speech atau speech-to-text yang bisa mengenali hampir 4.000 bahasa.

"Dalam proyek Massively Multilingual Speech (MMS), kami mengatasi beberapa tantangan ini dengan menggabungkan wav2vec 2.0, karya rintisan kami dalam pembelajaran mandiri, dan kumpulan data baru yang menyediakan data berlabel untuk lebih dari 1.100 bahasa dan data tidak berlabel untuk hampir 4.000 bahasa," kata Meta dalam pengumumannya, dikutip Selasa, 23 Mei.

Today we're sharing new progress on our AI speech work. Our Massively Multilingual Speech (MMS) project has now scaled speech-to-text & text-to-speech to support over 1,100 languages — a 10x increase from previous work.

Details + access to new pretrained models ⬇️

— Meta AI (@MetaAI) May 22, 2023

Selain itu, perusahaan mengklaim bahwa MMS memiliki keunggulan yaitu 10 kali lebih baik dan lebih banyak bahasa dibandingkan dengan model lainnya.

"Hari ini, kami membagikan model dan kode kami secara publik sehingga orang lain dalam komunitas riset dapat mengembangkan pekerjaan kami. Melalui karya ini, kami berharap dapat memberikan kontribusi kecil untuk melestarikan keragaman bahasa yang luar biasa di dunia," tambah perusahaan milik Mark Zuckerberg itu.

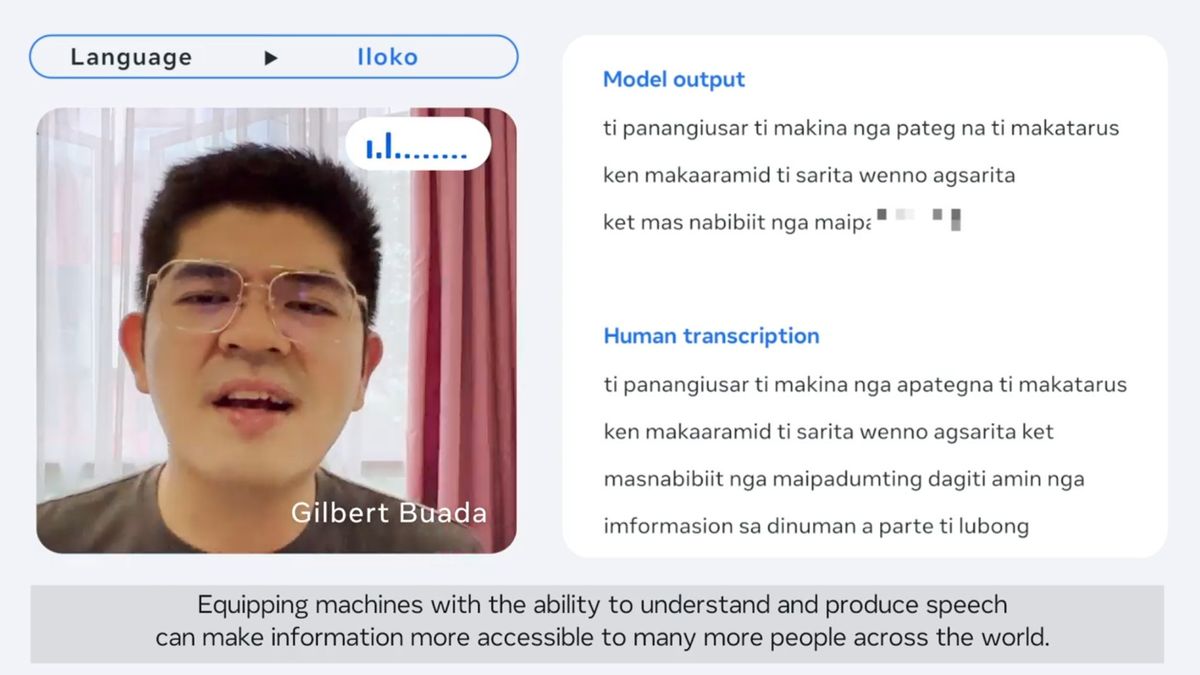

Berdasarkan demo yang dibagikan, dengan teknologi ini, MMS dapat menangkap seluruh kata yang Anda ucapkan menggunakan bahasa apapun ke teks. Begitupun sebaliknya.

BACA JUGA:

Meta juga membandingkan MMS dengan OpenAI's Whisper, dan menemukan bahwa model yang dilatih Meta untuk pidato multibahasa ini mencakup 11 kali lebih banyak bahasa dibandingkan OpenAI's Whisper.

"Ini menunjukkan bahwa model kami dapat bekerja dengan sangat baik dibandingkan dengan model ucapan terbaik saat ini," ujar Meta.

Dengan proyek Massively Multilingual Speech ini, perusahaan berharap bahwa di masa mendatang, mereka bisa meningkatkan cakupan bahasa untuk mendukung lebih banyak bahasa, dan juga mengatasi tantangan dalam menangani dialek, yang seringkali sulit untuk teknologi ucapan yang ada.

"Tujuan kami adalah mempermudah orang untuk mengakses informasi dan menggunakan perangkat dalam bahasa pilihan mereka," tutup Meta.