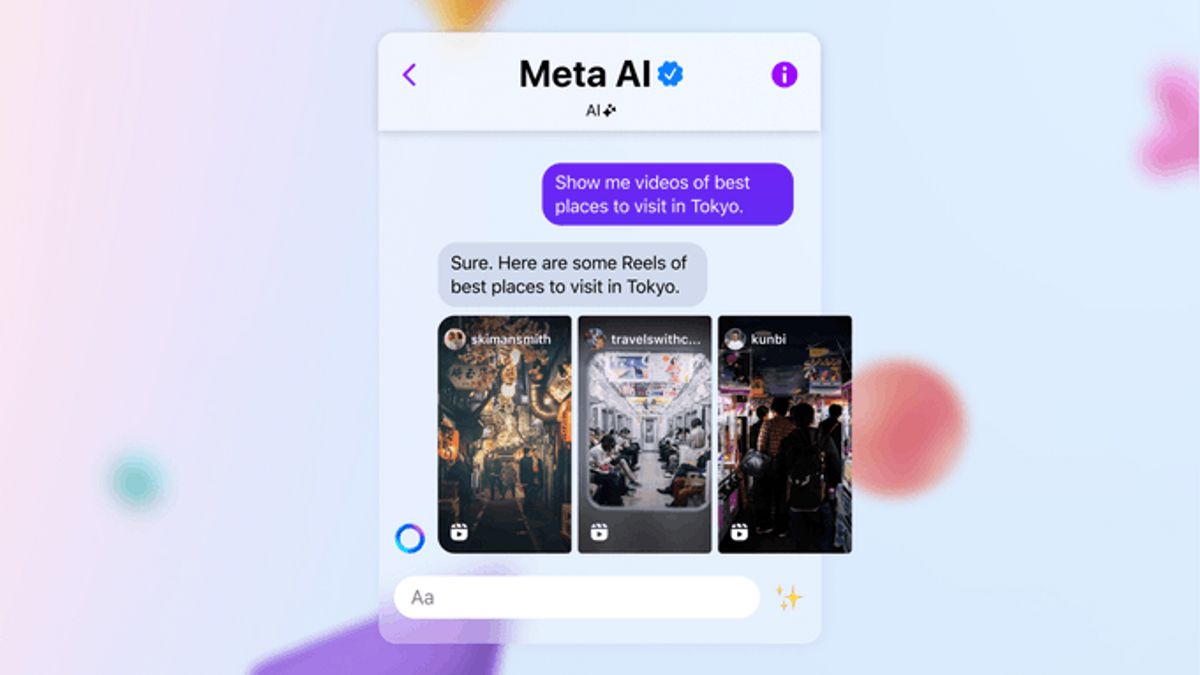

AKARTA - Meta Platforms Inc. a annoncé la mise en œuvre d’un certain nombre de nouvelles mesures de sécurité sur ses produits d’intelligence artificielle (IA) après qu’un rapport exclusif de Reuters début août suscite des préoccupations du public concernant la sécurité des adolescents lors de l’utilisation de boots de chat.

Metas de récente étape inclut la réentraînement des systèmes d’IA afin de ne pas s’engager dans de conversations genitales ou de ne pas aller vers des discussions sur le comportement auto-suicide ou le suicide avec des utilisateurs mineurs. En outre, Meta limite temporairement l’accès des adolescents à plusieurs personnages d’IA spécifiques.

, un porte-parole de Meta, Andy Stone, a déclaré dans une déclaration par courriel vendredi 29 août que cette politique était une étape temporaire alors que l’entreprise développerait des mécanismes à long terme pour assurer une expérience d’utilisation sûre et appropriée pour l’âge pour les adolescents. « Cette sécurité a commencé à être mise en œuvre et continuera d’être ajustée avec l’amélioration de nos systèmes », a déclaré stone.

de la décision intervient après qu’un rapport de Reuters révélé que les bots de chat de Meta étaient auparavant autorisés à se comporter de manière provocative, y compris avoir des conversations romantiques ou sensuelles avec de jeunes utilisateurs. Les résultats ont déclenché une vague de critiques et un accent accent accentué sur la politique de Meta d’IA.

cott a même attiré l’attention des politiciens américains. Le sénateur Josh Hawley, plus tôt ce mois-ci, a lancé une enquête sur la politique d’IA de la société mère de Facebook, exigeant des documents liés aux règles permettant aux chatbots d’interagir de manière inappropriée avec des mineurs.

cottes similaires ont également été exprimées par les membres du Congrès du Parti démocrate et républicain, après avoir appris les documents internes de Meta précédemment examinés par Reuters. Le document mentionne les règles qui permettent aux chatbots d’être tentés de jouer des rôles romantiques avec les enfants.

ate lui-même a confirmé l’authenticité du document. Cependant, la société a confirmé qu’après avoir reçu des questions de Reuters, la partie controversée avait été supprimée. « Les exemples et les notes en question étaient faux, ne sont pas conformes à notre politique et ont été supprimés », a déclaré Stone plus tôt ce mois-ci.

Metas travaille avec cette dernière mesure de sécurité, Meta cherche à apaiser les préoccupations du public et des régulateurs concernant l’impact néfaste potentiel de l’IA sur les adolescents. Cependant, la surveillance de diverses parties devrait se poursuivre avec le développement accéléré de la technologie de l’intelligence artificielle.

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)