人工智能(AI)的一种类型Deepfake,根据网络安全专家Pratama Persadha博士的说法,对选举和整个民主进程具有非常危险的潜力。

在2024年竞选期间,出现了“生成人工智能”一词或“生成人工智能”一词,这是能够生成具有人类特征的新内容、图像、文本或数据的人工智能技术的术语。

Pratama认为,AI世代已在各个领域应用,例如逼真的图像创建,文本创建,甚至用于网络安全目的。

人工智能基因是一种技术,包括印度尼西亚在内的各方都必须面对。其他一些试图规范人工智能基因使用的国家,包括澳大利亚,英国,中华人民共和国(中国),欧盟,法国,爱尔兰,以色列,意大利,日本,西班牙和美国。

Deepfakes 还解释说,Deepfakes 是用人工智能 (AI) 编辑的音频或视频录音,因此看起来 好像被录制的人确实说或做到了这一点。

公众可能仍然记得印度尼西亚共和国总统佐科·维多多(Joko Widodo)用曼达林语发表演讲的视频片段的流传。这是使用AI技术或Deepfakes或Deepfakes的恶作剧视频的一个例子,该视频在2023年底之前引起了公众的轰动,因为佐科威在他的国家演讲中看起来能流利地说曼达林语。

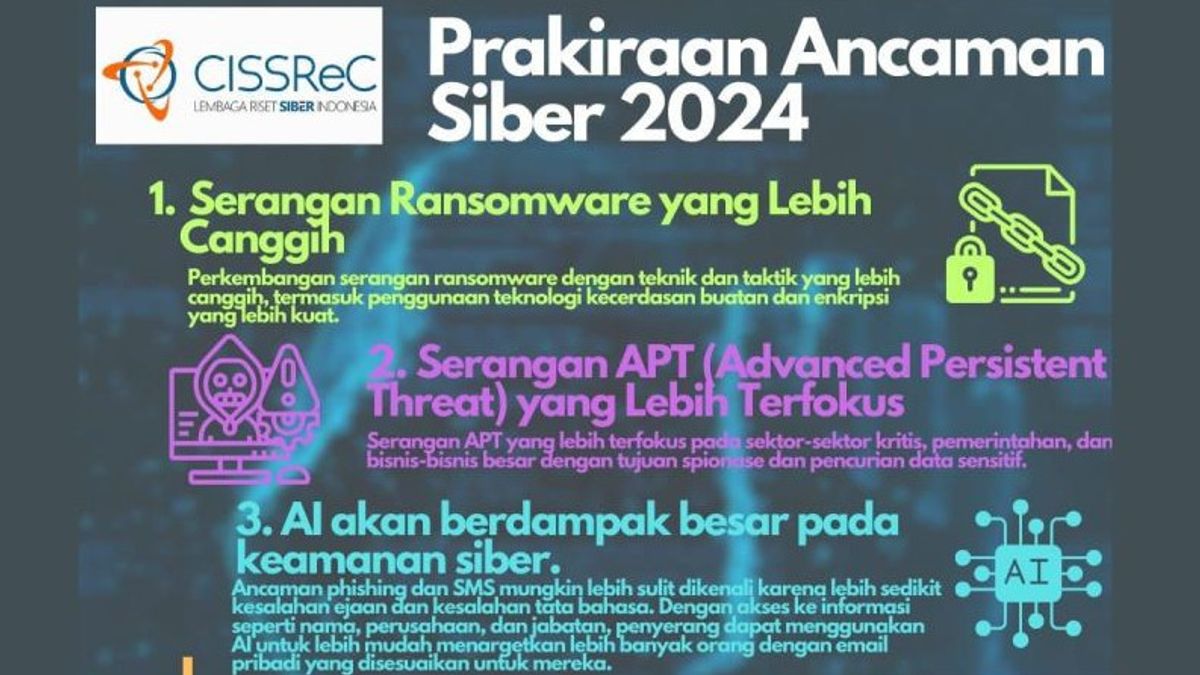

Pratama将AI基因比作双刃刀。一方面,AI基因还可以进行网络攻击,例如产生更复杂且难以检测的攻击,从而在攻击者和防御者之间创造更大的安全差距。

此外,人工智能技术是为了生成虚假内容,如deepfakes。这种类型的AI可以用于虚假信息活动或网络攻击,甚至可以尝试破解更强大的加密。

依赖技术也是负面的影响之一,因为人工智能基因可以促进日常工作,使人类不再习惯于定期工作。

Pratama说,所产生的信息的有效性仍然需要质疑,因为如果提供的用于训练系统的数据不是真的,那么人工智能世代就会产生不恰当的结果。

虚假音频或视频造成的后果等,误导选民,引起对特定候选人或问题的误解,目的是影响选举结果,污候选人的形象,并可能导致选民的不信任并损害他们的声誉。

此外,它影响选民对特定候选人或问题的看法和意见,甚至可能通过误导选民和影响他们的心态来影响选举结果。

特别是对于选民来说,为了不受Deepfakes的影响,不要盲目地盲目化,在每个选区(dapil)更接近立法候选人。同样,当你要在2024年总统大选中选择一对候选人时,你需要知道他们的记录。

在本案中,印度尼西亚共和国大选委员会(KPU)于2023年11月13日星期一确定,总统和副总统候选人有三对候选人将成为2024年总统大选的参与者。

根据2023年11月14日星期二举行的2024年总统大选参与者序列号的抽奖和确定结果,Anies Baswedan-Muhaimin Iskandar对序列号1,Prabowo Subianto-Gibran Rakabuming Raka序列号2,Ganjar Pranowo-Mahfud Md.序列号3。

根据Pratama的说法,与Deepfakes有关的其他事项可能导致社会混乱和不稳定,可能扰乱选举过程并影响结果。

此外,它加强了社会的两极分化,造成了日益严重的社会紧张,并可能使建设性的政治对话复杂化,阻碍达成协议的努力。

根据CISSReC网络安全研究所所长的说法,为了预测Deepfakes的各种危害,2016年关于2008年关于电子信息和交易的第11号法律修正案(ITE法)和关于个人数据保护的2022年第27号法律(PDP法)的第19号法律是不够的。

Pratama说,Deepfake是ITE法和PDP法中可能与文章纠缠的假新闻或恶作剧之一。但是,通过Deepfakes进行的假新闻肇事者也可以受到刑法典(KUHP)与欺诈和有关的额外指控的起诉。

随着制裁的增加,至少可能对那些打算在2024年竞选期间使用Deepfakes方法传播假新闻的政党产生威慑作用。

此外,如果假新闻问题也在《选举法》中受到监管,并受到严厉制裁的威胁,以至于可能缺席传播假新闻的候选人或政党的资格。

取消选举参与者资格的威胁,可能是立法者、政党和总统选举参与者的候选人,在使用Deepfakes创建和传播假新闻之前,会想得更久。

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)