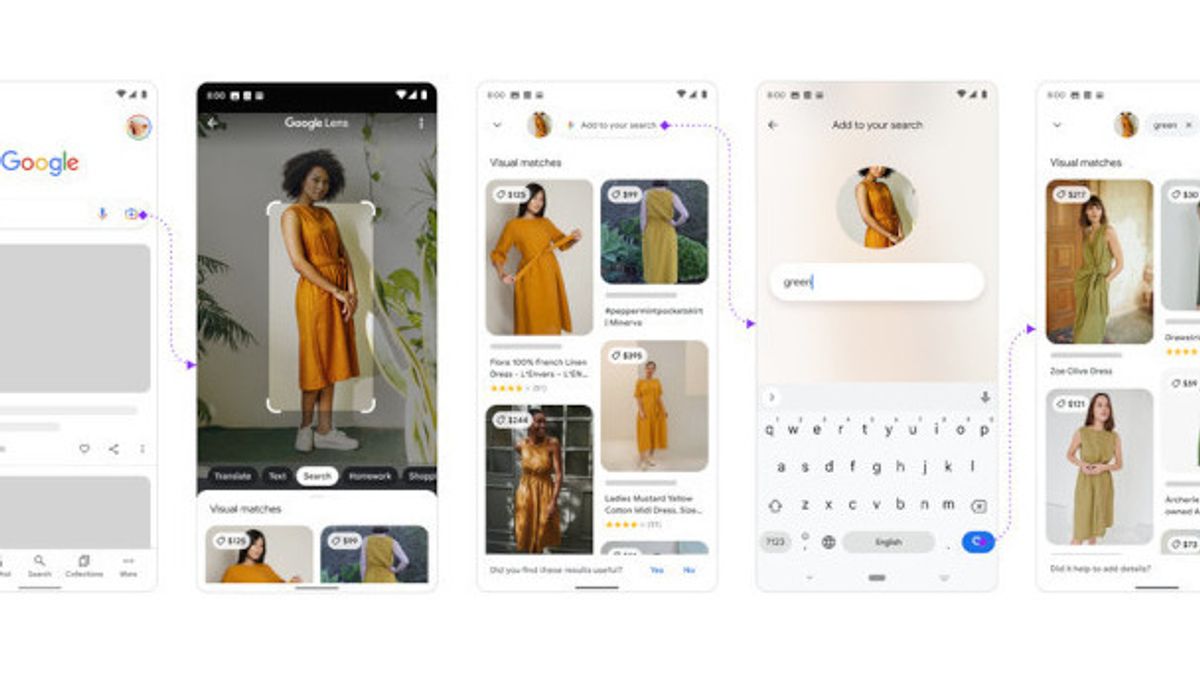

谷歌刚刚为其Google Lens推出了一项多搜索功能,允许用户搜索带有随附文本的图像,以帮助改善结果。

例如,如果用户看到首选的橙色连衣裙模型,但更喜欢找到以绿色销售该模型的商店,则用户可以拍摄橙色连衣裙的照片,并在文本字段中写上“绿色”,以显示类似连衣裙模型的结果,但为绿色。

此工具有多种用途,但总体而言,Google希望使其用户结果更具相关性。正如谷歌首席执行官桑达尔·皮查伊(Sundar Pichai)所说,新的多搜索功能是该公司使用人工智能的持续努力的一部分。

它旨在创建一种真正对话式、多模式化和个性化的信息体验。

目前,该功能仅在测试版中提供给使用英语文本进行搜索的美国用户。它也用于购物搜索。该公司尚未说明何时抵达另一个国家或另一种语言。

要使用此功能,用户只需打开Google应用程序,点击镜头相机图标,然后查找屏幕截图或拍摄新照片即可。然后,向上滑动并点击“+添加到搜索”按钮以添加文本。

此外,谷歌还表示,它正在探索如何通过谷歌最新的AI模型Multitask Unified Model(MUM)来改进该功能。

这家科技巨头最近分享了如何使用MUM和其他AI模型更有效地将有关危机救济的信息传递给寻求帮助的人。

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)