ジョギャジャカルタ - 現代の利点の一つは、コミュニケーションのしやすさです。アプリケーションの助けを借りて、私たちは今、さまざまな種類のメディアファイルを送信することができます - 写真、ビデオ、またはオーディオから。

しかし、犯罪行為は常にすべての開発に存在します。これは、コミュニケーションのしやすさの点でも例外ではありません。メディアファイルの配信が容易なおかげで、性的な性質の内容は広がりやすく、規模も広がります。

確かに、2人の大人の間でのみ、両当事者の同意を得て送信された場合、性的な内容は確かに問題ではありません。ただし、このコンテンツが同意なしに配布される場合は異なります。あるいは、コンテンツに子が含まれています。

間違いなく、それは再びカバーされました。誰かの性的欲求を満たすために子供のコンテンツの搾取は、今見つけやすくなっています。したがって、予防措置として、Appleは子供の安全のための追加機能を発表しました。

「ディは、コミュニケーションツールを使って子供たちを募集し、搾取する捕食者から子供たちを守るのを助けたいと考えています。児童の性的虐待資料(CSAM)の普及を制限するだけでなく、同社は先週、8月5日木曜日にアップロードされた公式ブログを通じて書いた。

3領域の子どもの安全機能子どもに対する犯罪の増大に直面するために、Appleは新しいセキュリティ機能を導入しています。子どもの安全に焦点を当てて、この機能の開発は、Appleが子供の安全専門家と協力した結果です。

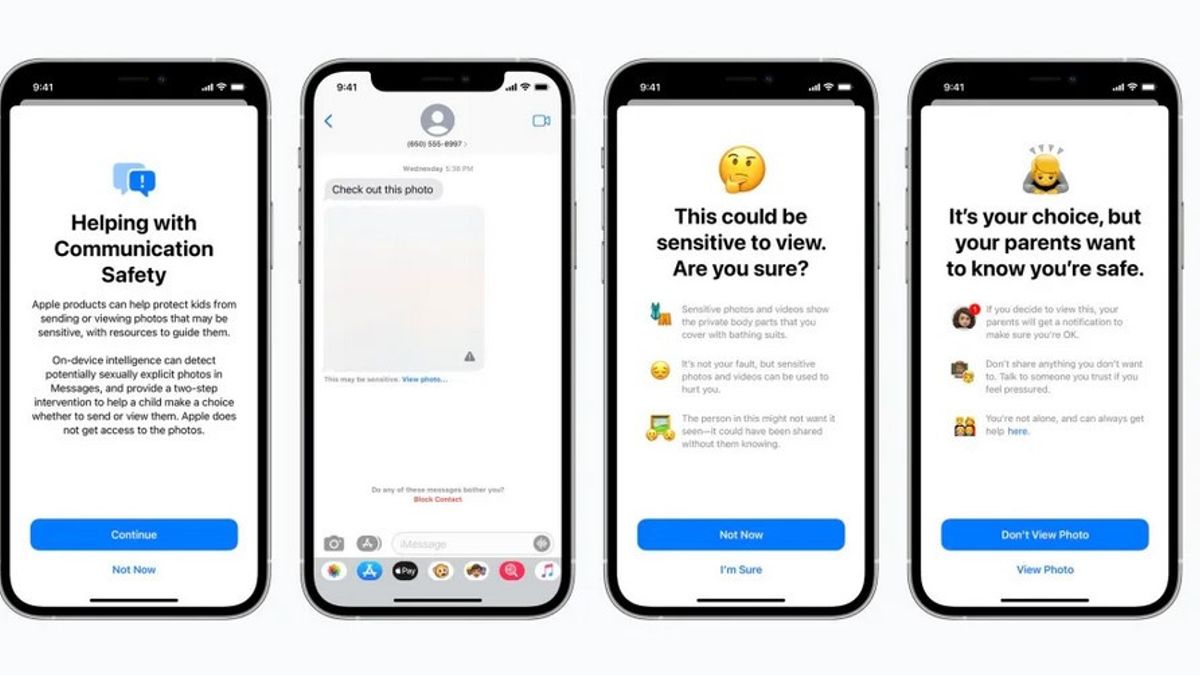

同社は、この新機能は3つの分野に焦点を当てると述べた。まず、親がより多くの情報を得て、オンラインコミュニケーション中に小さな子供たちを助けることを可能にする最新のコミュニケーションツール。

「(新しい)メッセージアプリは、Appleがプライベート通信を読み取るのを防いで、機密コンテンツに警告するために機械学習を使用します」と、同社は言いました。

この機能は、リトルワンのアカウントが明示的な写真を送受信したときに、子供と両親の携帯電話の画面にアラートを表示します。お子様の携帯電話が禁止されている写真を受信すると、その写真はぼやけます。

2つ目の機能は、iOS と iPadOS での暗号化の適用です。この技術は、CSAMコンテンツのオンライン拡散を制限できるだけでなく、ユーザーのプライバシーを維持するように設計されていると主張されています。CSAM の検出は、Apple が法執行機関に情報を提供するのに役立ちます。

最後に、親と子供がオンラインに行くことを容易にするSiriと検索のアップデートがあります。さらに、オンライン時に子供が危険な状態に巻き込まれた場合にも、セキュリティが強化されます。

「Siriと検索は、CSAM関連のトピックを探している場合、ユーザーにも介入します」と、同社は言いました。

アップルによると、これらの機能は、すぐに起動されるオペレーティングシステムの最新バージョンに存在する予定です。これには、iOS 15、iPadOS 15、watchOS 8、macOSモントレーが含まれます。

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)