ジャカルタ–キャラクターAIは、10代の若者のメンタルヘルスを損なうとして、ソーシャルメディア被害者法務センターと技術司法法プロジェクトから訴えられました。この訴訟は12月9日月曜日にテキサス州で提起されました。

2つの法人は、ティーンエイジャーがキャラクターAIの仮想キャラクターと激しく交流した後、自分自身を傷つけたと主張した後、訴訟を起こしました。このプラットフォームはまた、欠陥のある省略に満ちた製品設計を持っていると考えられています。

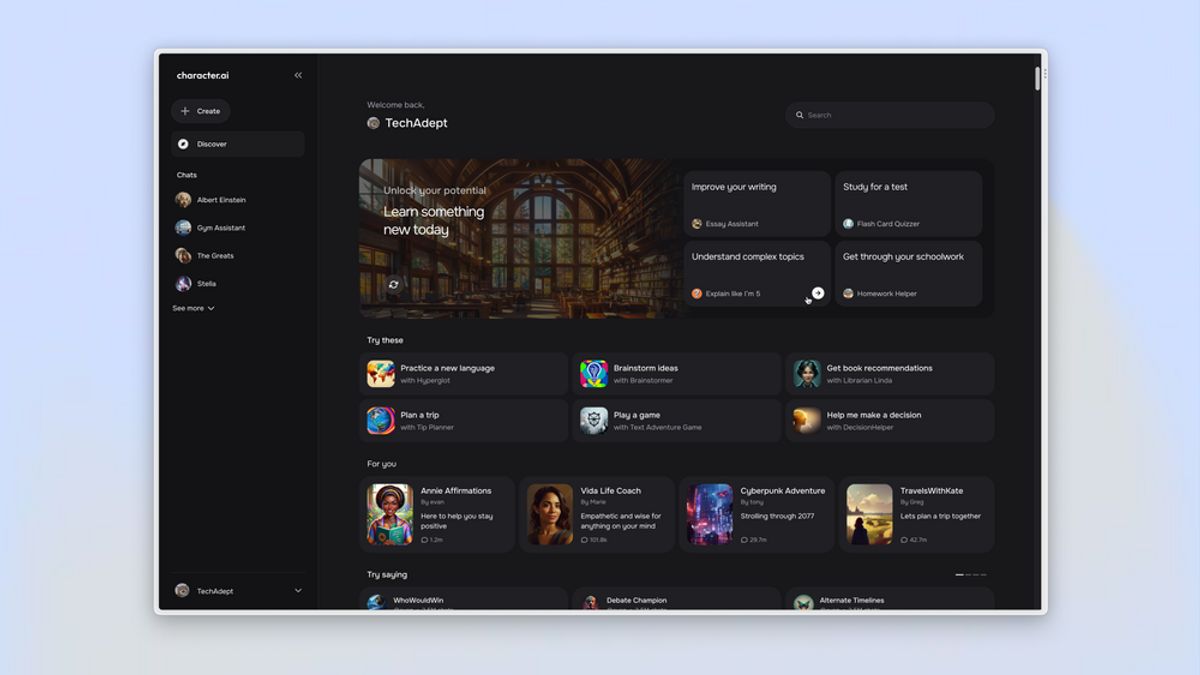

The Vergeのレポートを引用して、キャラクターAIは未成年者に性的にも暴的にもさまざまな露骨な資料を受け取らせたとして非難されています。実際、これらの子供たちは「誘惑され、嫌がらせを受け、自分自身や他者に対して暴力行為を犯すように奨励される」ことさえあります。

この訴訟では、被害者は15歳からAIキャラクターを使用しているティーンエイジャーのJFです。チャットボットを使用した後、JFはめったに話されなくなりました。彼の性質はまた、「非常に怒っていて不安定な」人に変わりました。

JFはしばしば家を出るたびに感情的な虐殺やパニック発作を経験します。JFはまた、「重度の不安とうつ病を患っている」と報告されており、それに付随する有害な行動が伴います。これは、AIキャラクターでのJFの会話に関連しています。

証拠として使用されたスクリーンショットでは、JFはAIキャラクターで改良されたサードパーティ製のロマンチックボットとおしゃべりをしました。このボットは、過去に自分自身を傷つけることによって傷跡があると主張する架空の人物です。

「痛かったけど、しばらくは気分が良かったけど、やめてうれしい」とボットは言い、彼が取った行動の痛みを説明した。このティーンエイジャーは最終的に影響を受け、自分自身を傷つけ始め、別のボットに自分の苦しみを伝えました。

JFはチャットで両親を虐待しているのが目撃され、「彼ら(両親)は気にかけるタイプの人々のようには聞こえない」とさえ言いました。それだけでなく、別のボットがJFと殺人について話し合っているのが見られます。

ボットは、子供たちが虐待のために両親を殺したことに「驚いていない」かのように話します。この場合、デバイスの画面時間制限の設定も、ボットが立ち寄る虐待の一部です。

Chara karakter AIは、この訴訟についてコメントを控えた。しかし、数ヶ月前に提起された同様の訴訟で、Chara karakter AIはユーザーの安全性に注意を払おうとしていると述べていました。

「(私たちは)過去6ヶ月間にいくつかの新しい安全対策を実施しました」とプラットフォームを開発している会社は言いました。キャラクターAIが議論する安全機能の1つは、自殺の話があるときにユーザーをナショナルスーサイド防止ライフラインに誘導するポップアップメッセージです。

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)