JAKARTA — OpenAI fait l’objet d’une enquête pénale aux États-Unis concernant le rôle présumé de son chatbot, ChatGPT, dans un cas de fusillade meurtrière qui a fait deux morts sur le campus de l’université d’État de Floride l’an dernier.

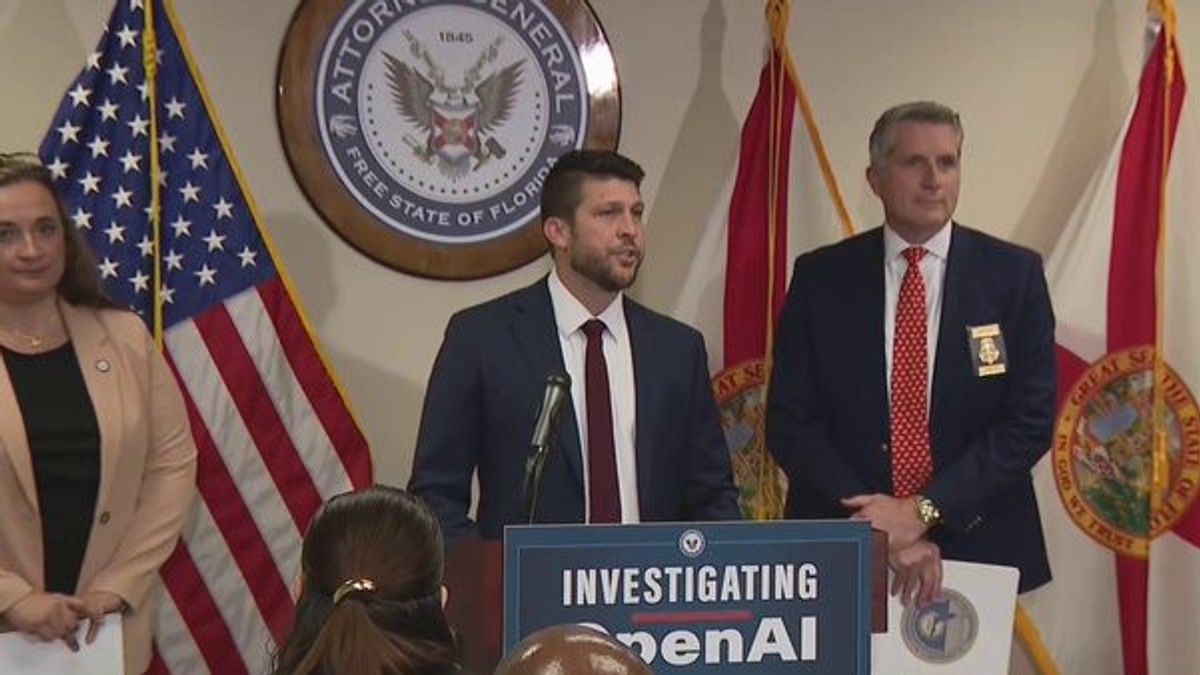

Le procureur général de Floride, James Uthmeier, a déclaré mardi (heure locale) que son bureau avait procédé à un examen préliminaire et avait trouvé suffisamment de fondements pour porter l’affaire à l’étape d’enquête pénale.

« Les résultats de notre examen montrent qu’une enquête pénale est nécessaire. ChatGPT a donné des conseils importants aux auteurs avant de commettre ces actes odieux », a déclaré Uthmeier.

Le suspect dans cette affaire est Phoenix Ikner, un étudiant de 20 ans actuellement en détention et en attente de procès.

Selon Uthmeier, le chatbot aurait donné des conseils sur les types d’armes et de munitions, ainsi que sur les heures et les lieux qui auraient permis à l’auteur de trouver un plus grand nombre de personnes sur le campus.

« Si les personnes derrière le rideau sont des humains, nous les inculquerons de meurtre », a déclaré Uthmeier, ajoutant que la loi de Floride permet aux parties qui aident ou encouragent une infraction d’etré considerées comme les principaux auteurs.

Cependant, OpenAI a nié cette implication. Dans sa déclaration, la société a affirmé que ChatGPT n’était pas responsable de cette infraction.

« ChatGPT ne encourage ni ne promeut aucune activité illégale ou dangereuse. Dans ce cas, le chatbot ne fournit qu’une réponse factuelle largement disponible sur Internet », a déclaré un porte-parole d’OpenAI.

L’entreprise a également déclaré avoir coopéré avec les forces de l’ordre et avoir activement transmis les données des comptes présumés liés aux suspects.

Ce cas est le premier où OpenAI a fait l’objet d’une enquête pénale concernant l’utilisation de ChatGPT par des individus qui ont ensuite été soupçonnés d’avoir commis des crimes graves. Cette situation ouvre un nouveau chapitre dans le débat mondial sur les limites de la responsabilité juridique des entreprises technologiques en ce qui concerne l’utilisation de leurs produits.

OpenAI a été fondé par Sam Altman et a commencé à être largement connu depuis le lancement de ChatGPT en 2022, qui est maintenant l'un des outils d'IA les plus utilisés au monde.

La pression sur l’industrie de l’IA a également augmenté au cours des derniers mois. Une coalition de procureurs généraux de 42 États américains a auparavant envoyé une lettre à un certain nombre d’entreprises technologiques, dont OpenAI, pour exiger des tests de sécurité plus stricts et des alertes sur les risques pour les utilisateurs.

D'autres cas renforcent également ces inquiétudes. Au début de cette année, l'incident de tir au Canada qui a fait neuf victimes a également été signalé comme impliquant l'utilisation de l'IA par le tireur. OpenAI a admis avoir fermé le compte concerné, mais n'a pas signalé l'incident à la police à l'époque.

Cette évolution place l'industrie de l'intelligence artificielle à un carrefour crucial : entre l'innovation rapide et les exigences de plus en plus strictes en matière de responsabilité juridique. Si auparavant l'IA était perçue comme un outil neutre, la grande question est maintenant : dans quelle mesure les fabricants sont-ils responsables ?

Au milieu de l'envolée de l'adoption de la technologie IA, cette affaire pourrait devenir un précédent important qui détermine l'orientation future de la réglementation mondiale.

Suivez la chaîne Whatsapp VOI

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)