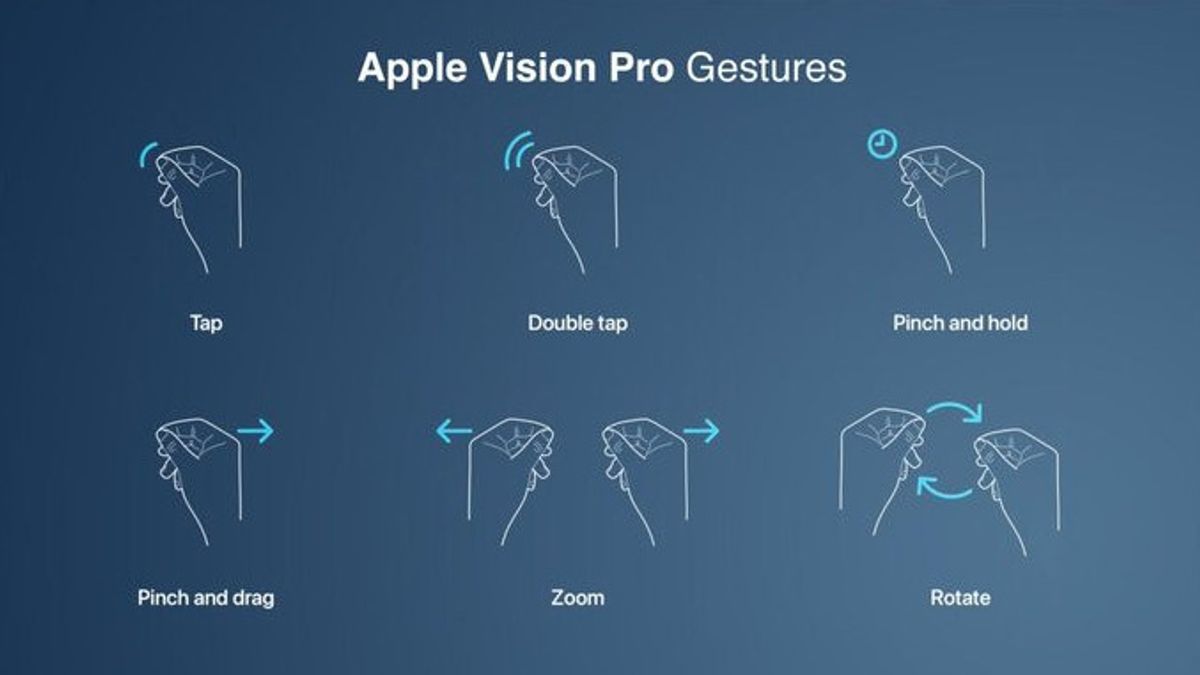

JAKARTA - Apple a de grands projets de rendre l’Apple Vision Pro plus accessible en permettant aux utilisateurs de contrôler l’appareil à l’aide de gestes cahiers.

Imaginez qu’il est dans un appel Zoom et peut éteindre le son comme un DJ de la radio en faisant un mouvement cinglant devant votre cou. Ou peut-être faites un signal ma main classique « appelle » et Apple Vision Pro enverra vos détails de contact à la personne que vous voyez.

C’est l’implication du dernier brevet donné à Apple, « méthode et appareil pour déterminer les gestionnaires de main personnalisées ». Il s’agit d’une méthode pour fixer n’importe quel geste sur la fonctionnalité Apple Vision Pro, et bien qu’il découle de la fonctionnalité d’accessibilité du casque, il a de nombreuses utilisations.

Lors des manifestations d’Apple Vision Pro, Apple dit souvent que ce casque d’écoute est l’appareil le plus accessible. Même pour une courte démonstration, il existe des options pour aider les utilisateurs avec des limites physiques.

« Dans diverses mises en œuvre, les appareils électroniques détectent des gestes de main plus déterminés effectués par les utilisateurs et, en réponse, exécutent les fonctions appropriées », a déclaré le brevet. « Cependant, dans diverses mises en œuvre, les utilisateurs peuvent ne pas être physiquement en mesure de faire des gestes de main précédemment déterminés ou peuvent vouloir que les gestes de main effectuent une fonction différente. »

C’est similaire à la fonctionnalité back Tap sur l’iPhone qui pourrait être introduite comme fonctionnalité d’accessibilité, mais offre une commodité de sorte qu’il peut être utilisé par n’importe qui. Et comme le back Tap, ce brevet suggère que le geste peut exécuter un court-circuit.

Cela ouvre de nombreuses possibilités. Tout geste le plus petit peut exécuter un court-circuit, ce qui signifie qu’il peut déclencher une série d’options.

Comme d’habitude, les brevets donnent plus la priorité sur la façon dont quelque chose peut être fait, plutôt que sur l’utilisation de la technologie. Cependant, dans 6 000 mots et 48 images, ce brevet explique comment les gestes futurs peuvent être détectés et déterminés à des tâches ou des fonctions.

Apprenez l’Apple Vision Pro à reconnaître les gestures

Chaque étape utilise ce qu’Apple appelle un outil d’association au geste, qui commence par demander quelles fonctions le geste veut faire par un utilisateur. Le brevet n’est en fait pas clair sur ce stade, mais l’utilisateur doit peut avoir sélectionné manuellement une fonction ou un raccourci.

Il y a aussi le fait que si le geste est un geste connu mais non utilisé, Apple Vision Pro peut le nommer pour vous. Par exemple, c’est quelqu’un qui regroupe les doigts, ce que mail est considéré comme un « Namaste ».

Si le geste n’est pas reconnu, l’outil lui demander un nom. Ensuite, demandez à l’utilisateur de répéter le geste - puis créer un geste similaire mais différent.

Après cela, de nouveaux gestus seront reconnus, et les tâches ou fonctions connexes seront effectuées. Apple n’a pas expliqué comment modifier ou supprimer le geste plus tard, mais il devrait y avoir un moyen de le faire - et bien sûr, de voir tous les gestus clandestins.

Le brevet d’Apple n’a pas non plus commenté si, par exemple, Apple Vision Pro refuserait de reconnaître le geste abusif.

Ce brevet, qui espère que tout le monde s’agira de bien, est crédité à deux inventeurs, Thomas G. Salter et Richard Ignatius Pusal Lozada. Tous deux ont de nombreux brevets précédents liés à la réalité augmentée et à l’environnement graphique.

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)