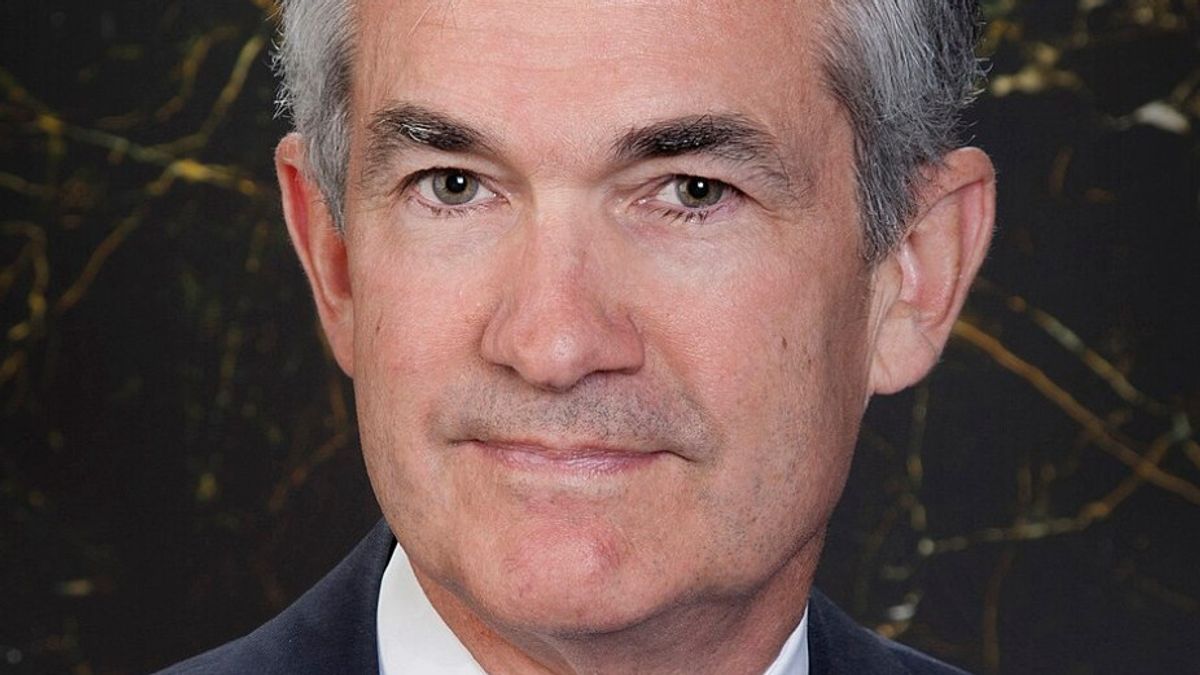

JAKARTA - Le gouvernement des États-Unis prend au sérieux les risques cybernétiques de l’intelligence artificielle. Anadolu Agency, citant un rapport de Bloomberg News vendredi 10 avril, rapporte que le ministre des Finances des États-Unis Scott Bessent et le président de la Fed Jerome Powell ont organisé une rencontre soudaine avec des dirigeants de Wall Street.

La rencontre a eu lieu mardi au ministère des Finances des États-Unis, à Washington. Le but est de s’assurer que les grandes banques comprennent les potentiels menaces des derniers modèles d’intelligence artificielle ou IA de Anthropic, Mythos et d’autres systèmes similaires.

Selon le rapport, les responsables veulent voir si les plus grandes banques des États-Unis sont suffisamment prêtes à faire face à la nouvelle menace d’un modèle d’IA de plus en plus puissant. Les inquiétudes ne sont pas sans importance. Les régulateurs estiment que la nouvelle génération d’IA pourrait être utilisée pour lancer des cyberattaques plus complexes et plus difficiles à lire. Si cela se produit, il n’y aura pas qu’une seule banque perturbée, mais cela pourrait se propager au système financier.

Les banques appelées ne sont pas non plus de petites banques. Ce sont de grands acteurs dont l’impact est vaste. Si l’un d’eux a un problème, l’effet peut rapidement se propager au système financier mondial. Les noms cités sont notamment les PDG de Citigroup Jane Fraser, de Morgan Stanley Ted Pick, de Bank of America Brian Moynihan, de Wells Fargo Charlie Scharf et de Goldman Sachs David Solomon. Le PDG de JPMorgan Jamie Dimon n’est pas présent.

Anthropic décrit Mythos comme un modèle beaucoup plus puissant. Si l'utilisateur le demande, ce modèle est censé être capable de trouver et d'exploiter des failles de sécurité sur les principaux systèmes d'exploitation et navigateurs web. C'est ce qui a renforcé les inquiétudes des régulateurs. Les technologies de plus en plus intelligentes peuvent également rendre les risques plus difficiles à contrôler.

L’accès à Mythos lui-même est toujours restreint. Anthropic ne l’a ouvert qu’à un petit nombre d’entreprises de technologie et de financéées majeures, dont Amazon, Apple et JPMorgan Chase. Le schème est géré par une initiative nommée Project Glasswing, qui vise à sécurisé les systèmes importants avant que des mod̀les similaires ne soient lancés plus largement.

Anthropic a également dit avoir discuté avec des responsables américains avant la sortie du modèle, y compris sur sa capacité cybernétique à attaquer et à se défendre. Mais en même temps, la société est également en conflit avec le gouvernement Trump devant les tribunaux. Le litige a émergé après que le Pentagone a désigné Anthropic comme un risque de chaîne d’approvisionnement. Au début de la semaine, la cour d’appel fédérale a temporairement rejeté la demande d’Anthropic de mettre fin à cette nomination.

Pour les grandes banques, les modèles d’IA de plus en plus sophistiqués sont maintenant considérés comme une nouvelle source de risque. En effet, une perturbation d’un système peut rapidement se propager à un système financier plus large.

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)