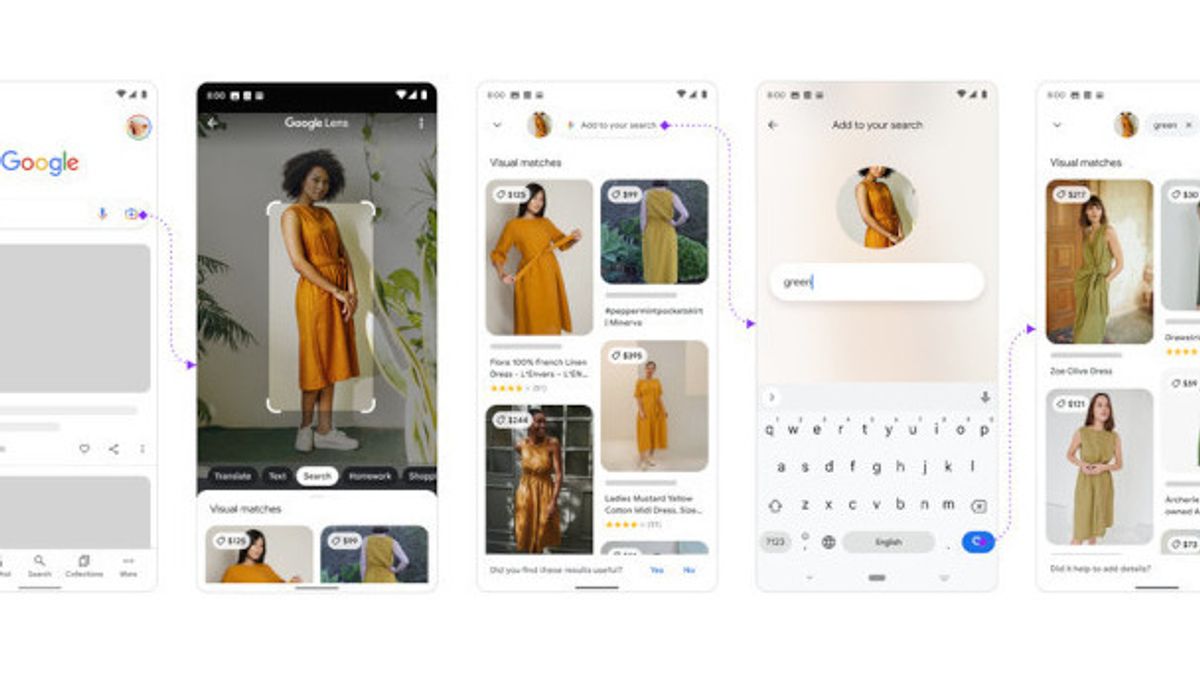

Googleは、Googleレンズのマルチ検索機能を開始したばかりで、ユーザーは結果を改善するためにテキストが添付された画像を検索することができます。

たとえば、ユーザーが好みのオレンジ色のドレス モデルを見ても、それを緑色で販売する店舗を検索することを好む場合、ユーザーはオレンジ色のドレスの写真を撮り、テキスト フィールドに 'green' と入力して、類似したモデルのドレスの結果を緑色で表示できます。

このツールにはさまざまな用途がありますが、Googleは全体的にユーザー結果をより関連性のあるものにしたいと考えています。GoogleのCEOであるSundar Pichai氏が述べたように、新しいマルチ検索機能は、AIを使用するための同社の継続的な取り組みの一環である。

これは、真に会話型、マルチモーダル、そして個人的な情報体験を創造することを目指しています。

現在、この機能は、英語のテキストで検索する米国のユーザーのみがベータ版で利用できます。また、ショッピング検索も対象としています。同社は、いつ他の国や他の言語に到着するかは述べていない。

この機能を使用するには、ユーザーはGoogleアプリを開き、[レンズカメラ]アイコンをタップしてから、スクリーンショットを探すか、新しい写真を撮るだけです。次に、上にスワイプして[+ 検索に追加]ボタンをタップしてテキストを追加します。

さらに、4月8日(金)にZDNetをローンチしたGoogleは、Googleの最新のAIモデルであるMultitask Unified Model(MUM)で機能を改善する方法を模索していると述べた。

このテクノロジーの巨人は最近、MUMやその他のAIモデルを使用して、助けを求める人々に危機救済に関する情報をより効果的に中継する方法を共有しました。

The English, Chinese, Japanese, Arabic, and French versions are automatically generated by the AI. So there may still be inaccuracies in translating, please always see Indonesian as our main language. (system supported by DigitalSiber.id)